3月21日,大模型预训练前沿技术报告第一场在线上成功举办。报告由中国中文信息学会(CIPS)计算语言学专业委员会执委委员、复旦大学邱锡鹏教授主持,计算语言学专业委员会副主任、哈尔滨工业大学车万翔教授、北京并行科技股份有限公司AI云事业部总经理赵鸿冰博士致辞,上海人工智能实验室青年科学家颜航作了题为《大模型长上下文数据与方法》的主题报告分享。

大模型预训练前沿技术报告系列直播课是由中国中文信息学会计算语言学专业委员会主办、并行科技承办的以大语言模型预训练技术为内容方向的系列公益直播课,旨在分享大模型预训练技术前沿学术成果和普及大模型预训练中的超算应用,面向大模型领用的科研工作者和高校师生展开。

中国中文信息学会计算语言学专业委员会副主任、哈尔滨工业大学车万翔教授致辞

中国中文信息学会计算语言学专业委员会副主任、哈尔滨工业大学车万翔教授致辞表示:以ChatGPT为代表的大模型技术自发布之日起,国内外就掀起了大模型热潮。各类报告会数不胜数,但是大部分是围绕如何改进大模型、如何应用大模型、以及对大模型对社会的影响等问题展开。关于大模型本身是如何预训练的,在预训练过程中会遇到哪些具体问题,以及如何解决这些问题的报告却很少,也不系统。而CIPS计算语言学专委会主要聚焦于自然语言处理领域研究,致力于组织国内外相关的学科的学术交流,促进国内学术界以及国际对口学术组织的交流和合作推动。所以CIPS计算员学专委会联合并行科技,举办该系列直播课来系统介绍大模型背后的预训练技术,同时也希望能够为相关领域的科研工作者和高校的师生创造一个互相学习、交流的平台。

北京并行科技股份有限公司AI云事业部总经理赵鸿冰博士致辞

北京并行科技股份有限公司AI云事业部总经理赵鸿冰博士致辞表示:大模型的发展依靠先进的算法和海量的数据,更需要超大规模的算力作为基础支撑。并行科技作为国内专业的、领先的大模型算力服务提供方,已广泛地为复旦大学、哈尔滨工业大学、上海人工智能实验室、清华大学、北京大学等高等学府和科研机构,以及智谱华章等顶尖的AI初创企业提供了大规模、高质量的GPU算力及服务。通过先进、灵活的调度和丰富的产品矩阵,良好地满足了大规模预训练、微调、高并发推理和高精度科研计算中对计算、存储、网络等环节的多样化需求。

AI之争的最巅峰是人才的较量。中国中文信息学会计算语言学专业委员会和并行科技都把人才培养作为己任,本次双方联合推出了这档“大模型预训练前沿技术报告”系列直播课,旨在为观众们分享最前沿、最先进的大模型技术,以共同促进中国人工智能发展。

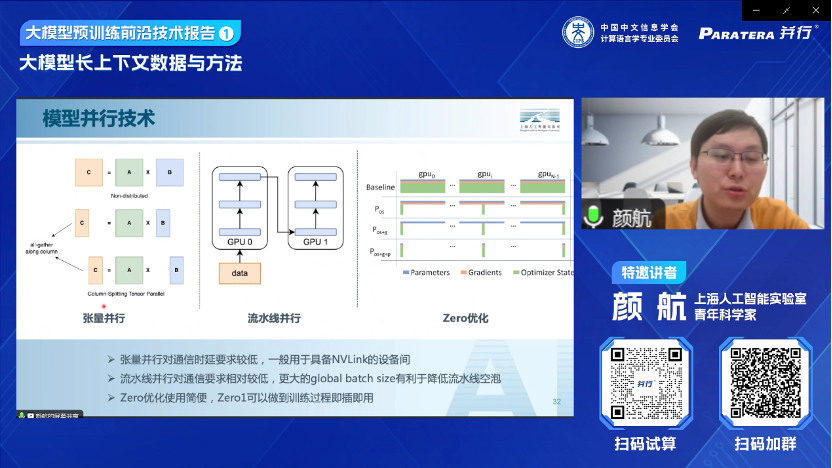

上海人工智能实验室青年科学家颜航作《大模型长上下文数据与方法》主题报告

《大模型长上下文数据与方法》主题报告聚焦大型模型的长语境能力,分享了上海人工智能实验室OpenLMLab团队在长上下文预训练数据、模型及训练等方面进行的探索以及如何成功将这些研究成果融合至InternLM2系列模型中,从而实现了200k的上下文长度处理能力。

颜航老师首先探讨了如何准备高质量的预训练数据,并介绍了上海人工智能实验室开发的长上下文预训练数据集LongWanjuan;接着总结了当前长上下文模型的技术发展路线,最后分享了其团队在长上下文训练领域的实践经验。

中国中文信息学会计算语言学专业委员会执委委员、复旦大学邱锡鹏教授主持报告

主题报告结束之后,报告嘉宾颜航老师和主持人邱锡鹏教授还与直播间观众进行了互动答疑。观众提问积极,反响热烈,直播间气氛一度达到高潮。

大模型预训练前沿技术报告系列公益直播课计划共举办四场,固定播出档期为周四19:00。每期邀请一位大模型领域的知名专家学者,进行约一小时的学术报告分享。直播课的播出平台为:B站【CIPS计算语言学专委会】、视频号【并行科技】、B站【并行科技】。欢迎各界朋友观看和交流。