6月18日至19日,首届中国大模型大会(CLM 2024)在北京举行,中国中文信息学会计算语言学专业委员会承办“大模型+计算语言”专题论坛。论坛邀请到北京大学穗志方教授、中国科学院自动化研究所刘康研究员、清华大学东昱晓副教授作特邀报告。特邀报告结束后,举行了由清华大学刘洋教授主持的专题研讨会,中国科学院自动化研究所刘康研究员、复旦大学邱锡鹏教授、哈尔滨工业大学车万翔教授、清华大学东昱晓副教授共议前沿议题。此次论坛由并行科技提供技术支持全程在线直播,吸引了上万人次的线上观看,反响热烈。

特邀报告由中国科学院软件研究所韩先培研究员主持,北京大学穗志方教授作了题为“大语言模型的知识能力探究”的技术报告。报告认为虽然ChatGPT等大型语言模型引领了人工智能领域的重大变革,但在从传统人工智能迈向通用人工智能的过程中,深度神经网络依然存在一些本质性问题,如黑箱模式、知识鸿沟和评测失真等。报告围绕如何更全面、准确地评估大型模型知识能力这一问题。从符号、认知和跨模态等多个角度介绍评估大模型知识能力的方法,并进一步探究大语言模型在与人类相比时的认知短板和能力边界。

北京大学穗志方教授作报告

中国科学院自动化研究所刘康研究员做了题为“大语言模型中的知识探索”的技术报告。报告认为大语言模型已经展示了从海量数据中习得知识的能力,但其知识存储机制以及从海量数据中归纳和抽象化知识的能力仍有待深入探讨。报告结合课题组的最新研究,介绍了面向大语言模型的不同知识类型的定位、探测及归纳方法。

中国科学院自动化研究所刘康研究员作报告

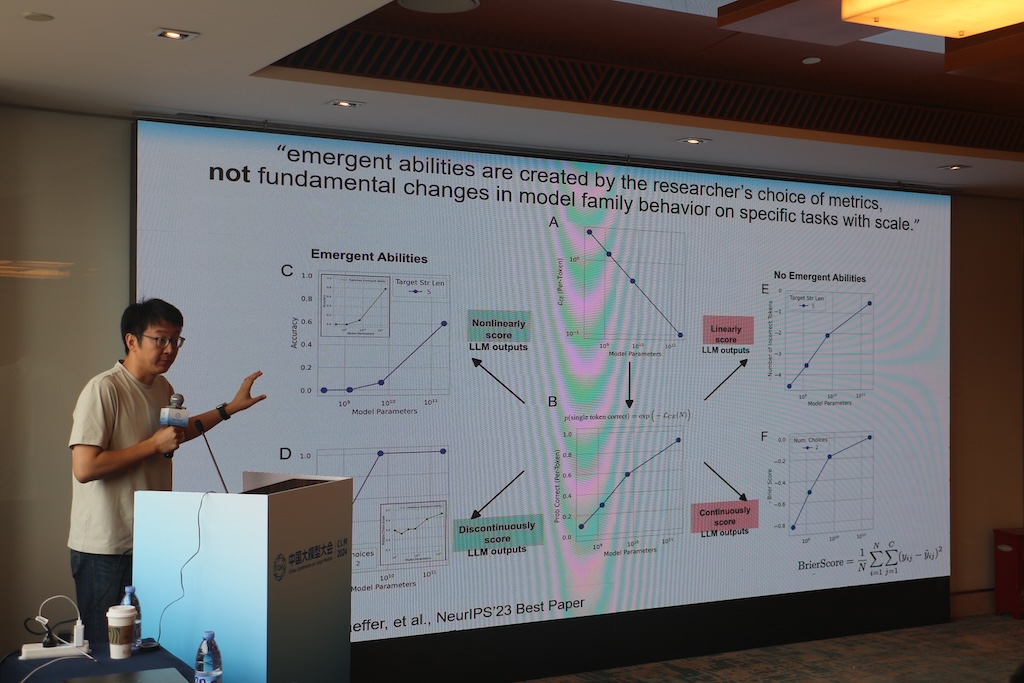

清华大学东昱晓副教授的报告题目是“GLM-4:理解与探索大模型能力涌现”的技术报告。报告分享了在GLM-4模型智能体能力提升方面的探索,发现相较于模型大小或计算量,预训练损失能更有效预测语言模型的涌现能力,从而合理指导模型训练与能力提升。以GLM-4 All Tools模型为例,其能够自主理解用户意图,自动规划复杂指令,自由调用网页浏览器、代码解释器和多模态模型等以完成各种复杂任务。

清华大学东昱晓副教授作报告

在特邀报告之后,进行了专题研讨会。此次研讨会由清华大学刘洋教授主持,参与讨论的嘉宾包括中国科学院自动化研究所刘康研究员、复旦大学邱锡鹏教授、哈尔滨工业大学车万翔教授、清华大学东昱晓副教授。他们共同探讨了前沿议题,并积极回应了现场观众的问题。

专题研讨会