“第二十三届中国计算语言学大会”(The Twenty-third China National Conference on Computational Linguistics, CCL 2024)将于2024年7月25-29日在山西太原举行,会议由中国中文信息学会计算语言学专业委员会主办,山西大学承办。

中国计算语言学大会创办于1991年,由中国中文信息学会计算语言学专业委员会主办。经过30余年的发展,中国计算语言学大会已成为国内自然语言处理领域权威性最高、规模和影响最大的学术会议。作为中国中文信息学会的旗舰会议,CCL聚焦于中国境内各类语言的智能计算和信息处理,为研讨和传播计算语言学最新学术和技术成果提供了最广泛的高层次交流平台。

本次大会由清华大学孙茂松教授、山西大学梁吉业教授担任大会主席。

前沿动态综述报告于7月28日15:00—18:00展开,由上海人工智能实验室青年科学家颜航、北京大学研究员杨耀东、西湖大学教授张岳、北京理工大学教授毛先领、南京大学副教授黄书剑、哈尔滨工业大学教授冯晓骋、中国人民大学准聘副教授林衍凯、中国人民大学陈旭、复旦大学副教授魏忠钰和中国科学院计算技术研究所副研究员庞亮做分享报告。讲者将就大模型的热点话题进行探讨分享。

大会已经开启注册,期待与各位学者的相遇!

网站:http://cips-cl.org/static/CCL2024/index.html

预训练:颜航

上海人工智能实验室 颜航

题目:大语言模型合成数据方法简述

简介:大语言模型在过去两年受到了极大的关注,并引起了对通用人工智能的广泛讨论。为了实现通用人工智能,合成数据被认为是其中非常关键的一环。本文将当前常见的数据合成方法归为三类:基于蒸馏的合成数据、基于模型自我进化、基于工具的合成数据。针对每一类合成数据方法,我们简要介绍了几种主流的做法,以期概览各类方法的基本思路以及异同。

讲者:颜航,上海人工智能实验室青年科学家。研究兴趣包括信息抽取、开源NLP工具建设、大规模预训练模型等。开源平台OpenLMLab主要贡献者,设计并开发了InternEvo、fastNLP、fitlog等开源工具,负责了浦江实验室InternLM大模型的预训练相关工作。在ACL、TACL、EMNLP、NAACL等会议或杂志上发表了多篇论文,2022年获钱伟长中文信息处理科学技术奖一等奖(4/5)。

对齐:杨耀东

北京大学 杨耀东

题目:对齐的理论、技术与评估

简介:对齐(Alignment)是实现大模型与人类意图和价值相一致的核心手段。近年来,随着大模型的迅速发展,对齐技术受到越来越多的关注。本报告从对齐的理论、技术与评估三个方面,对大模型的对齐技术进行了前沿介绍。

讲者:杨耀东博士,北京大学人工智能研究院研究员、AI安全与治理中心执行主任、博雅青年学者。国家高层次留学人才计划、国家高层次青年人才项目、中国科协青年托举计划获得者。重点研究多智能体交互博弈与价值对齐问题,科研方向包括强化学习和多智能体系统。发表顶会顶刊论文一百余篇,谷歌引用五千余次,获得国际顶会最佳论文奖(含提名)3次,学术新星奖2次,主持负责国自然、科技部、市科委、校企联合实验室等科研课题二十余项。工作曾被《焦点访谈》、《深度国际》、金融时报、麻省科技评论头条等报道。本科毕业于中国科学技术大学,硕士于伦敦帝国理工大学,博士于伦敦大学学院(获校唯一ACM SIGAI优博奖提名),并曾于伦敦国王大学任助理教授。

推理:张岳

西湖大学 张岳

题目:大模型逻辑推理研究综述

简介:逻辑推理能力是评价人工智能系统的一个重要指标。近年来,随着大模型技术的发展,逻辑推理受到越来越多关注。本报告从发展历史、评测体系、能力量化和提升方法四个角度对大模型逻辑推理进行前沿介绍。

讲者:张岳,西湖大学教授,工学院副院长。主要研究领域为自然语言处理,学术贡献包括结构预测机器学习算法框架、自然语言处理神经网络基础模型、可信赖的自然语言处理等。著有剑桥大学出版社《自然语言处理—机器学习视角》,编写牛津参考文献自然语言处理。担任国内外顶级会议CCL 2020、EMNLP 2022程序委员会共同主席,以及TACL、TASLP等期刊编委。获ACL 2018(提名)、COLING 2018、IALP 2017、SemEval 2020、ACL 2023(提名)等国际会议的最佳论文奖。入选斯坦福全球2%科学家、爱思唯尔中国高被引学者等榜单。

评测:毛先领

北京理工大学 毛先领

题目:生成式文本质量的自动评估方法综述

简介:如何对生成式文本的质量进行高效评估是智能时代非常重要的一个基础问题。与人工评估方法相比,自动评估由于其成本低廉,受到了越来越多关注,发展非常迅速。本报告将对现有生成式文本质量的自动评估方法进行分类与总结。

讲者:毛先领,北京理工大学教授、博导。主要研究信息检索与数据挖掘。目前担任计算机学会中文信息技术专委会委员、中文信息学会青工委执委以及语言与知识专委会委员;已在SIGIR、WWW、SIGMOD、ACL、TOIS、TKDE等国际期刊会议上发表50余篇论文;主持研发了Hammer PDF等系列科技大数据挖掘系统,部分成果获2项最佳论文奖和3项省部级科技进步奖。

多语:黄书剑

南京大学 黄书剑

题目:大模型时代的多语言研究综述

简介:进入大语言模型时代以来,多语言研究发生了巨大变化。一些传统任务得到了突破性的解决,以多语言大模型为基础,涌现出许多面向大模型能力提升的多语言研究工作。本文针对这一新变化,整理归纳了进入大模型时代以来的多语言研究进展,包括多语言大模型的开源模型、数据集、多语言任务等;深入探讨了三个重要的前沿研究方向,包括多语言模型训练、跨语言对齐、多语言机制分析等;并进一步指出了研究面临的公平性与安全性、多语言诅咒、多语言训练代价等研究挑战。

讲者:黄书剑,博士,南京大学计算机科学与技术系副教授,博士生导师。主要研究方向包括机器翻译、文本分析与理解、多语言大模型等。现任中文信息学会理事,中文信息学会机器翻译专委会副主任,曾任中文信息学会青年工作委员会执行委员等。担任国内自然语言处理会议NLPCC2022、机器翻译会议CCMT2019程序委员会共同主席、CWMT2017、2018评测委员会主席等。2019年获中国中文信息学会杰出服务奖,2020年获中国计算机学会自然语言处理与中文计算奖-青年新锐奖,2022年获钱伟长中文信息处理奖-青年创新奖。

检索增强:冯骁骋

哈尔滨工业大学 冯骁骋

题目:大模型时代下的检索增强:发展趋势、挑战与展望

简介:大语言模型(LLMs)在各种自然语言处理任务上表现出了卓越的性能,但它们很容易受到时效性、领域专业性和幻觉现象的影响。为了应对这些挑战,研究人员探索整合不同外部信息来增强大语言模型,其最主要方法就是检索增强。在本文中,我们以检索策略和内容处理策略为中心整理现有的检索增强技术,总结现有的检索增强方法会面临的问题:何时需要通过检索来增强大型语言模型?如何利用检索得到的信息和知识优化大模型生成的内容?最后,总结和梳理检索增强的未来主要研究方向。希望本报告对学术界和工业界有所帮助。

讲者:冯骁骋,哈尔滨工业大学计算学部社会计算与信息检索研究中心教授(入选校青年人才拔尖计划)、博导。计算机科学与技术学院副院长。研究兴趣包括自然语言处理、文本生成、机器翻译等。在CCF A/B类国际会议及期刊发表论文40余篇。据Google学术统计,论文引用数量超5000次。担任NIPS、ICML、AAAI、IJCAI、ACL等国际会议程序委员会高级/普通成员;兼任鹏城实验室双聘副研究员、中国中文信息学会青工委副主任、2023-2024中国计算机协会YOCSEF哈尔滨分论坛现任主席等。入选中国科协第六届青年人才托举工程,曾获一级学会中国中文信息学会优秀博士学位论文奖、黑龙江省科技进步二等奖、中国计算机学会自然语言处理专委会青年新锐奖和世界人工智能大会(WAIC)-云帆奖等。

工具学习:林衍凯

中国人民大学 林衍凯

题目:大模型工具学习进展与挑战

简介:近年来,大模型在自然语言处理、计算机视觉、生物学等诸多领域展现出惊人的应用价值。大模型在大规模预训练中获得的在复杂交互环境中的非凡理解、推理、规划和决策能力,进而展现出在复杂真实场景下调用工具解决复杂任务的巨大潜力。本报告的内容为大模型工具学习,介绍大模型如何能够理解和使用各种工具来完成任务,包括其统一框架、主要挑战、重要进展和未来方向。

讲者:林衍凯,中国人民大学高瓴人工智能学院准聘副教授,主要研究方向为预训练模型和大模型智能体,在CCF A/B类国际顶级学术会议发表论文50余篇,Google Scholar统计引用达到1.3万次,2020-2024年连续三年入选爱思唯尔(Elsevier)中国高被引学者和斯坦福大学全球前2%顶尖科学家。其成果获评教育部自然科学一等奖、 2022年世界互联网大会领先科技成果(全球共15项)。

智能体:陈旭

中国人民大学 陈旭

题目:基于大语言模型的自主智能体概述

简介:近年来,大语言模型智能体受到了学术界的广泛关注,本报告中,讲者将概要介绍智能体的基本组成部分,包括画像模块、记忆机制和推理模块等,同时,讲者将介绍智能体能力提升的主要手段和未来可能面临的挑战等。

讲者:陈旭,博士毕业于清华大学,目前在中国人民大学高瓴人工智能学院工作,他的研究方向是大语言模型和推荐系统等,曾在计算机领域顶级会议SIGIR、TheWebConf、ICML、ICLR等上发表多篇论文,谷歌引用超过6000次,多次获得(提名)国际会议的最佳论文奖,也担任了多个国际会议/期刊的审稿人。

多模态:魏忠钰

复旦大学 魏忠钰

题目:从多模态预训练到多模态大模型:架构、训练、评测、趋势概览

简介:过去一年,多个多模态大模型面世,包括GPT-4、Gemini、QWen-VL、CogVLM等,相关功能让人感到惊艳。这些模型可以回答图片相关的问题,做OCR,理解网上的梗图,但也存在严重的幻觉问题。本次报告介绍大视觉语言模型发展的三个阶段,即多模态联合预训练、以语言模型为中心的大视觉语言模型和原生大视觉语言模型,并介绍当前学术界关心的一些研究热点。

讲者:魏忠钰,复旦大学大数据学院副教授,博士生导师,数据智能与社会计算实验室(Fudan DISC)负责人,自然语言处理(Fudan NLP)团队成员。现任中国中文信息学会(CIPS)情感计算专委会副秘书长、中国计算机学会(CCF)自然语言处理专委会副秘书长,曾任CIPS青工委副主任等。主要研究领域包括自然语言处理、多模态大模型技术和社会计算,推出DISC-X系列领域大模型,覆盖医疗、金融、司法、网络治理等四个领域。曾获得2019年度CIPS社会媒体处理专委会新锐奖、2021年上海市启明星计划、2022年CCF自然语言处理专委会新锐学者奖。

信息检索:庞亮

中国科学院计算技术研究所 庞亮

题目:大语言模型时代的信息检索综述

简介:以大语言模型为代表的生成式人工智能迅猛发展,标志着人工智能从判别时代向生成时代的转变。大语言模型对信息检索领域的影响,从性能改进到模式颠覆。针对传统信息检索流程,大语言模型凭借强大的语义理解和建模能力,显著增强索引、检索和排序等信息检索模块的性能。同时,大语言模型取代传统信息检索的趋势,和催生的新的信息获取方式,或将是新一次信息时代的寒武纪。此外,大语言模型对内容生态的深远影响也值得关注。

讲者:庞亮,中国科学院计算技术研究所智能算法安全重点实验室副研究员,新加坡国立大学访问学者,研究方向为自然语言生成和信息检索。在国际会议发表过论文30余篇,谷歌引用超过2700。担任国际会议程序委员和期刊审稿人、中文信息学会信息检索专委会常务委员、中文信息学会青工委执委、中国科学院青促会会员。曾获中文信息学会优秀博士学位论文奖。提出的深度文本匹配模型在Kaggle QQP文本匹配比赛中获得全球第四。NeurIPS 2018多智能体挑战赛强化学习全球冠军。多跳开放问答HotpotQA位列全球榜单第一。

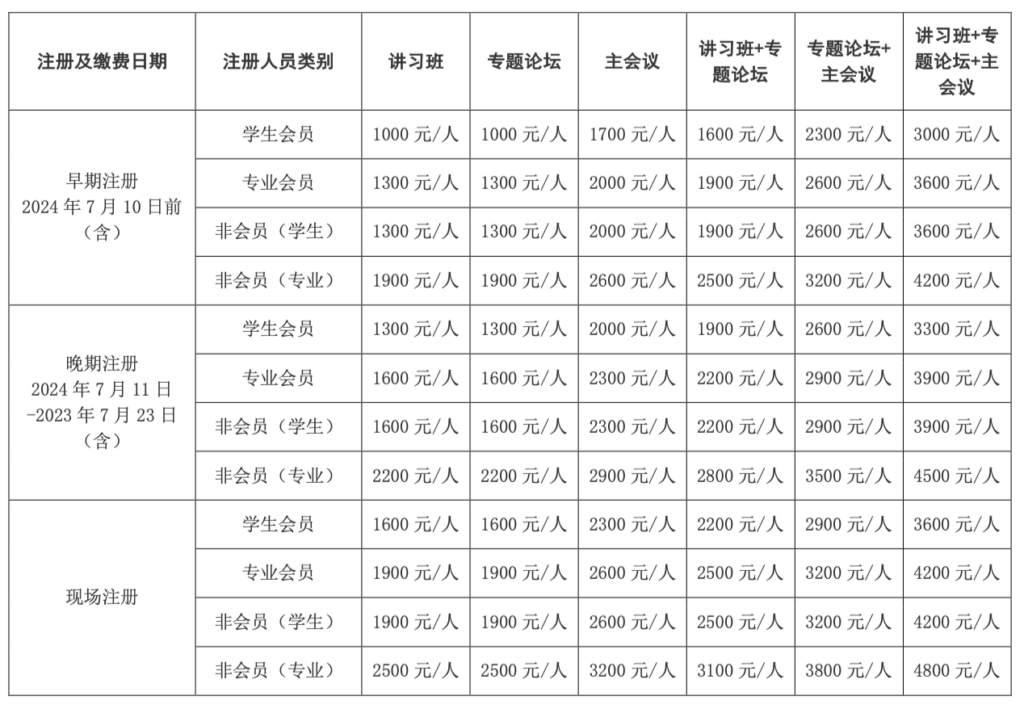

CCL2024大会注册信息

会议安排:

- 2024年7月25日:讲习班

- 2024年7月26日:专题论坛、学生研讨会

- 2024年7月27-29日:主会议

会议注册:

- 注册网址:http://cips-cl.org/static/CCL2024/cclRegistration/registration/index.html

- 查询会员:https://www.cipsc.org.cn/Memberinquiry/index.aspx

- 注册会员:https://www.cipsc.org.cn/Register.aspx

注:

- 会议期间食宿、交通费用自理;中国中文信息学会会员缴费:学生会员50元/人;专业会员200元/人。

- 退款说明:因财务系统试运行中,已缴纳注册费暂不支持退款,可以抵用学会其他会议注册费,感谢理解!

- 每篇被正式录用的会议论文必须至少有一名作者注册主会议。

会议酒店及交通

会议地址:山西潇河国际会议中心

酒店预订方式:请扫码通过CCL 2024酒店预定系统进行预定

- 会务、住宿、交通等问题,可邮件联系:ccl_2024@163.com

- 张老师:15536602009

- 王老师:13453145789

- 方老师:13643454755