中国中文信息学会计算语言学专委会于2025年7月12日在厦门大学成功举办学术沙龙活动。此次活动由中国中文信息学会计算语言学专委会主办,厦门大学信息学院苏劲松教授、史晓东教授和陈毅东副教授承办,专委会线下活动工作组参与组织。本次活动的专委会邀请嘉宾包括哈尔滨工业大学车万翔教授(副主任、秘书长)、四川大学雷文强教授、复旦大学桂韬副研究员(委员)、清华大学周浩副研究员。围绕计算语言学领域的前沿热点问题,包括长思维链机理及应用、推理智能体、大模型智能体进展与思考、长上下文大模型等领域,展开了深入研讨。来自厦门大学的100余名师生和专家,共同参加了本次学术交流活动。

活动合影

学术沙龙于7月12日9:00正式开始,苏劲松教授主持整个交流活动。共分为4个主题报告。

车万翔教授报告《迈向推理时代——长思维链机理及应用》

哈尔滨工业大学车万翔教授作了题为《迈向推理时代——长思维链机理及应用》的报告,系统地阐述了长思维链的核心技术与机制,重点涵盖了深度推理的逻辑形式与学习框架、反思能力的反馈与纠错机制、探索能力的扩展机制,以及内部与外部探索框架等关键内容。

雷文强教授报告《智能体的革命——聚焦核心要素与能力演进》

四川大学雷文强教授作了题为《智能体的革命——聚焦核心要素与能力演进》的报告,围绕知识推理与交互,分析了大模型智能体在两方面能力的进展,并提出一些可以进步的方向。

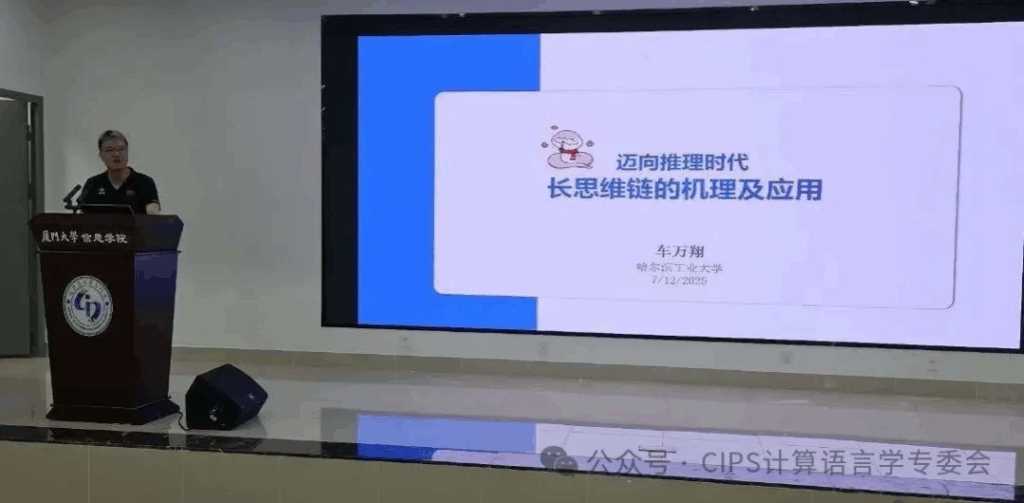

桂韬副研究员报告《推理智能体》

复旦大学桂韬副研究员作了题为《推理智能体》的报告,围绕基于大模型的智能体综合框架,讨论如何让智能体具备更强的推理及泛化能力,并提供对此类智能体未来发展的见解。

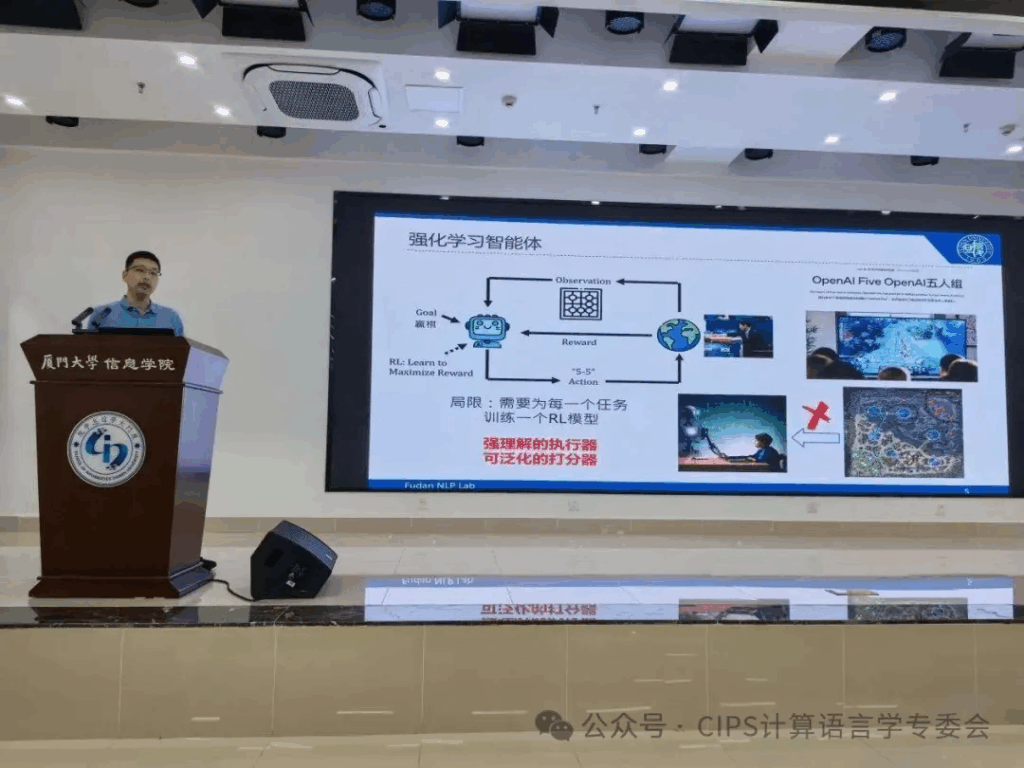

周浩副研究员报告《MemAgent: Reshaping Long-Context LLM with Multi-Conv RL based Memory Agent》

清华大学周浩副研究员作了题为《MemAgent: Reshaping Long-Context LLM with Multi-Conv RL based Memory Agent》的报告。报告围绕大模型处理长文本时的效率和性能问题,提出了端到端优化的MemAgent工作流。该方法显著缓解了传统方法在上下文外推时的性能衰减问题。

本次活动的成功举办,有助于更深入地理解大语言模型在推理,智能体及长上下文应用等几个方面的实现原理,从计算语言学的角度助力人工智能技术发展。

为更好地传播自然语言处理领域最新的学术和技术成果,中国中文信息学会计算语言学专委会计划于2025年以走进高校或企业等形式组织一系列线下学术交流活动,诚邀申办,活动申请链接:https://docs.qq.com/form/page/DUFVZZ1BzZndMaFZG